Güvenilir Yapay Zekâ

Yapay zekâ sistemlerinin geliştirilebilmesi, uygulanabilmesi ve kullanılabilmesi için güvenilirliğe ihtiyaç duyulmaktadır. Bu amaçla dünyada çeşitli güvenilir yapay zekâ tanımları yapılmış ve güvenilirlik için çeşitli ilke ve değerler benimsenmiştir. Bu yazıda bazı örnek ilke ve değerlerden bahsedeceğiz.

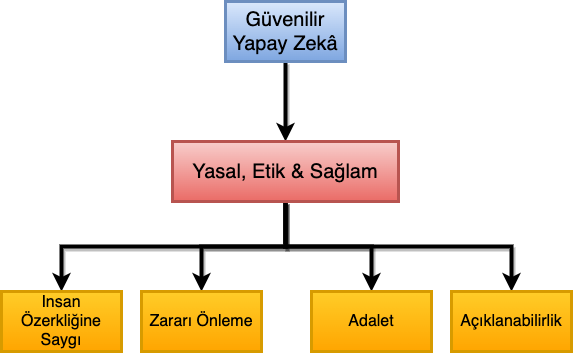

İlk olarak, Avrupa Komisyon’u tarafından kurulan Yapay Zekâ Konusunda Üst Düzey Uzman Grubu’nun önerdiği ilke ve değerlere odaklanalım. Yapay Zekâ Konusunda Üst Düzey Uzman Grubu yayınladığı “Güvenilir YZ için Etik İlkeler” isimli belgede güvenilir yapay zekâ kavramı, sistemin tüm yaşam döngüsü boyunca üç ana bileşeni içermesi üzerine kurulmuştur: 1) yasal olması yani geçerli tüm yasa ve düzenlemelere uygun olması, 2) etik olması yani etik ilke ve değerlere bağlı olması ve 3) teknik ve sosyal açıdan sağlam olması [1]. Güvenilir yapay zekâ için benimsenmesi gereken dört etik ilke belirtilmiştir: 1) İnsan özerkliğine saygı, 2) Zararı önleme, 3) Adalet ve 4) Açıklanabilirlik ilkeleri [1].

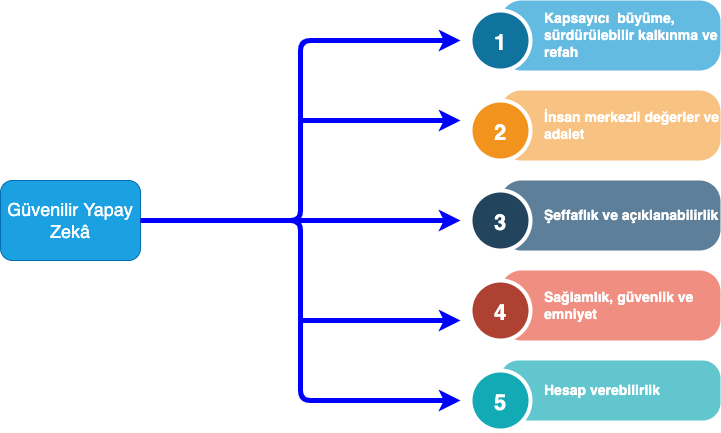

Bir diğer inceleyeceğim ilke ve değerler OECD tarafından önerilmiştir. OECD güvenilir yapay zekâyı değerlere dayalı ilkelerle uyumlu yapay zekâ olarak tanımlamıştır [2]. Bu bağlamda beş tane değerlere dayalı ilke belirlemiştir: 1) Kapsayıcı büyüme, sürdürülebilir kalkınma ve refah, 2) İnsan merkezli değerler ve adalet, 3) Şeffaflık ve açıklanabilirlik, 4) Sağlamlık, güvenlik ve emniyet ve 5) Hesap verebilirlik [2]. OECD’nin ilkeleri, G20 tarafından da kabul edilmiştir.

UNESCO Ad Hoc Uzman Grubu tarafından yayınlanan “Yapay Zekâ Etiği ÜzerineTavsiye” metninin ilk taslağında güvenilirlik, belgedeki ilkelerin işlevselleştirilmesinin bir sonucu olarak kabul edilmiştir ve bu çerçevede dört değer ve on ilke belirlenmiştir [3]. Bu değerler, 1) İnsan onuruna, insan haklarına ve temel özgürlüklere saygı gösterilmesi, korunması ve geliştirilmesi, 2) Çevre ve ekosistem gelişimi, 3) Çeşitliliğin ve kapsayıcılığın sağlanması ve 4) Uyum ve barış içinde yaşamaktır [3]. İlkeler ise 1) Ölçülülük ve zararvermeme, 2) Emniyet ve güvenlik, 3) Adalet ve ayrımcılık yapmama 4) Sürdürülebilirlik, 5)Mahremiyet, 6) İnsan gözetimi ve belirlemesi, 7) Şeffaflık ve açıklanabilirlik, 8) Sorumluluk ve hesap verebilirlik, 9) Farkındalık ve okuryazarlık ve 10) Çok paydaşlı ve uyarlanabilir yönetişim ve iş birliği [3].

Güvenilir yapay zekâ ilke ve değerleriyle karşılaşabileceğimiz bir diğer doküman ise Türkiye Ulusal Yapay Zekâ Stratejisi’dir. Türkiye Ulusal Yapay Zekâ Stratejisi’nde “güvenilir ve sorumlu YZ” için dört değer ve sekiz ilke benimsenmiştir. Bu değerler, 1) İnsan Hakları, Demokrasi ve Hukukun Üstünlüğüne Saygı, 2) Çevreyi ve Biyolojik Ekosistemi Geliştirmek, 3) Çeşitliliğin ve Kapsayıcılığın Sağlanması ve 4) Barışçıl, Adil ve Birbirine Bağlı Toplumlarda Yaşamaktır [4]. İlkeler ise 1) Ölçülülük, 2) Emniyet ve Güvenlik, 3) Tarafsızlık, 4) Mahremiyet, 5) Şeffaflık ve Açıklanabilirlik, 6) Sorumluluk ve Hesap Verebilirlik, 7) Veri Egemenliği ve 8)Çok Paydaşlı Yönetişimdir [4].

Türkiye Ulusal Yapay Zekâ Stratejisi’nde benimsenen ilke ve değerlerin dünya genelinde güvenilir yapay zekâ bağlamında kabul edilen ilke ve değerlerle paralel ve uyumlu olduğu görülmektedir.

Yazan : Gamze Büşra Kaya

Referanslar

[1]Ethics guidelines for Trustworthy Ai. Shaping Europe's digital future. (n.d.). Retrieved October 11, 2022, from https://digital-strategy.ec.europa.eu/en/library/ethics-guidelines-trustworthy-ai

[2]OECD AI Principles overview. The OECD Artificial Intelligence (AI) Principles - OECD.AI. (n.d.). Retrieved October 11, 2022, from https://oecd.ai/en/ai-principles

[3]Recommendation on the ethics of artificial intelligence. Unesdoc.unesco.org. (n.d.). Retrieved October 11, 2022, from https://unesdoc.unesco.org/ark:/48223/pf0000380455

[4]Ulusal Yapay Zekâ stratejisi 2021-2025. Türkiye Cumhuriyeti Cumhurbaşkanlığı Dijital Dönüşüm Ofisi - Ulusal Yapay Zekâ Stratejisi 2021-2025. (n.d.). Retrieved October 11, 2022, from https://cbddo.gov.tr/uyzs