Güvenilir Yapay Zekâ İhtiyacı

Yapay zekâ sistemleri adalet sistemi, işe alım, tıp ve bankacılık gibi hayatın çeşitli alanlarında giderek daha fazla kullanılmaktadır ve bu alanları şekillendirmektedir. Yapay zekâ sistemleri, insanlığın yaşadığı birçok probleme çözüm üretebilecek ve insanlığa büyük faydalar sunabilecek potansiyeldedir ve çoktan birçok alanda insanlar için faydalı olmaya başlamıştır.

Fakat faydalarla beraber yeni etik, yasal ve sosyal zorluklar da getirmektedir [1]. Yapay zekâ sistemlerinin kullanımından kaynaklı problemler ortaya çıkmaktadır. Suç tekrarı riskini tahmin etmek için kullanılan “COMPAS” algoritmasının siyahilere karşı ön yargılı olması, bir yüz tanıma yazılımının siyahileri uygun olmayan etiketlerle etiketlemesi ve bir özgeçmiş tarama sisteminin kadınlara karşı ön yargılı olması ortaya çıkan problemlerden bazılarıdır [2]. Bu problemler, çarpıcı örnekler olmalarıyla beraber yapay zekâ sistemlerinin dikkatsiz kullanımının toplumsal yaşamı şekillendiren adalet ve eşitlik gibi değerleri tehdit eder nitelikte olduğunu gösterir. Yapay zekâ sistemlerinin kullanımından kaynaklanan etik, yasal ve sosyal problemler sistemlerin güvenilmez davranması, yorumlanabilir ve açıklanabilir olmamasından kaynaklanabilmektedir. Önyargının kara-kutu sistemini yanlış yönlendirmesi ve sistemlerin karmaşıklığı kararların nasıl alındığını anlaşılamaz kıldığı için sistemlerin kullanımı konusunda endişeler ortaya çıkmaktadır [2].

Bu endişeler yapay zekâ sistemlerinin kullanımına engel teşkil etmektedir. Örneğin, yapay zekâ tabanlı tıbbi tanı destek sistemleri çok faydalı olduğu halde yorumlanabilir olmadığı için sağlık profesyonelleri tarafından pek güvenilmemekte ve kabul görmemektedir [2]. Yani sistemlerin kullanımından kaynaklı zorluklar ortaya çıkabildiği gibi insanlar için çok faydalı olabilecek sistemler insanların güvenini kazanamadığı için pek kullanılmamaktadır. Yapay zekâ sistemlerinden tam anlamıyla faydalanabilmek için onların sebep olabileceği etik, yasal ve sosyal zorlukların üstesinden gelinmeli, insanlara zarar vermemesi sağlanmalı ve insanlar arasında onlara karşı güven oluşturulmalıdır. Bu bağlamda faydalı YZ, sorumlu YZ ve etik YZ gibi “YZ’nin riskleri ve tehlikeleri azaltılırken veya önlenirken faydaları en üst düzeye çıkaracak şekilde ilerlemesi”ni hedefleyen farklı yaklaşımlar ortaya konmuştur [1].

Benzer amaçla ortaya atılan terimlerden birisi de güvenilir YZ’dir. Avrupa Komisyonu'nun Yapay Zekâ konusunda bağımsız Üst Düzey Uzman Grubu’nun “Güvenilir Yapay Zekâ için Etik İlkelerini” yayınlamasının ardından güvenilir YZ terimi benimsenmeye başlanmıştır [1]. Güvenilir YZ, YZ’nin tüm potansiyelini gerçekleştirebilmesi için ona güven tesis edilmesi gerektiği fikrine dayanmaktadır [1]. Dünya genelinde kabul edilmiş bir kavramdır. Gartner’ın tahminleri güvenilir YZ’ye duyulan ihtiyacın önemini göstermektedir. Tahminlere göre, 2025 yılına kadar tüm YZ tabanlı dijital ürünlerin %30'unun güvenilir bir YZ çerçevesini kullanması gerekecektir ve kullanıcıların %86'sının etik YZ ilkelerini kullanan şirketlere güvenecek ve sadık kalacaktır [2].

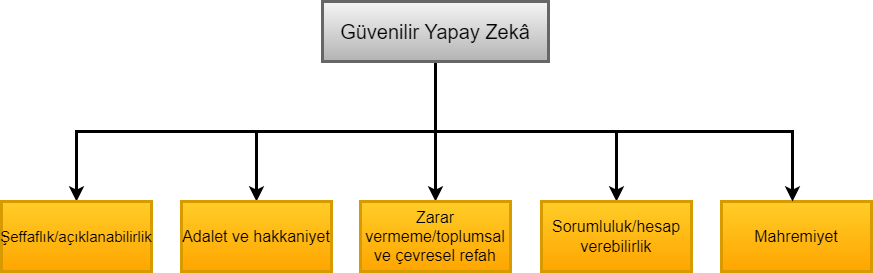

Fakat yapay zekâyı neyin güvenilir kıldığı konusunda bir fikir birliğine varılamamıştır ve güvenilir YZ için yerine getirilmesi gereken gereksinimler dünya genelinde eşit derecede ve aynı şekilde önceliklendirilmemektedir [2]. Bu sebepten ötürü bazı araştırmacılar güvenilir YZ çerçevesinde önerilen ilkeleri incelemiş ve diğerlerinden daha sık önerilen beş ilke belirlemiştir: şeffaflık/açıklanabilirlik, adalet ve hakkaniyet (tarafsızlık), zarar vermeme/toplumsal ve çevresel refah, sorumluluk/hesap verebilirlik ve mahremiyet [2].

Güvenilir YZ Çerçevesinde Önerilen İlkeler

Bu kısımda, güvenilir YZ çerçevesinde en sık önerilen beş ilkenin tanımları ve bu ilkelere neden ihtiyaç duyulduğu incelenecektir. İlk olarak, hakkaniyet ilkesi YZ sistemlerinin toplumdaki herhangi bir kişi veya gruba karşı ayrımcılığa neden olmamasını gerektirir [2]. YZ sistemleri doğru bir şekilde tasarlanmadıkları, geliştirilmedikleri ve uygulanmadıkları takdirde yanlılığa ve adaletsizliğe yol açabiliyor [2]. YZ sistemlerinin yanlılık ve adaletsizliğe yol açmaması için hakkaniyet ilkesiyle uyumlu olması gerekmektedir. Açıklanabilirlik ilkesi “otomatik ve algoritmalara dayanılarak alınan kararların, bu kararlara yol açan verinin ve o veriden elde edilen bilginin; neden, nasıl, nerede ve ne amaçla kullanıldığı, teknik olmayan terimlerle ve yalın bir dille son kullanıcıya ve diğer paydaşlara açıklanabilme”sini gerektirir [3]. YZ sistemleri tarafından verilen kararlara güven sağlayabilmek için, bu sistemlere dâhil olan farklı paydaşların bir karara yol açan nedenleri anlamaları esastır [2]. Yani açıklanabilirlik ilkesiyle uyum YZ sistemlerine güven oluşturabilmek için gereklidir. Hesap verebilirlik, sorumluluğun paydaşlar arasında dağıtılmasını gerektirir [2]. Hesap verilebilirliğe duyulan ihtiyaç algoritmik karar vermenin çeşitli yüksek riskli uygulamalarda kullanımından kaynaklanmaktadır ve bu sistemlerin güvenli ve güvenilir olmasını sağlamak için hesap verilebilirlik gereklidir [2]. Mahremiyet ilkesi, “bir kişi tarafından paylaşılan veya bir yapay zekâ sistemi tarafından toplanan hassas verilerin herhangi bir haksız veya yasa dışı veri toplama ve kullanımına karşı korunmasını sağlar” [2]. Mahremiyetin korunması kullanıcıların sisteme güvenini sağlamak açısından hayati öneme sahiptir. Veri ihlalleri bilginin ve verinin suiistimal edilmesine sebep olabilir ve bu da kullanıcıların sisteme güvenini azaltabilir [2]. Bu nedenle güveni sağlamak için sistemin ve kullanıcıların mahremiyetinin sağlanmalıdır. Son olarak, zarar vermeme ilkesi, yapay zekânın insanlara zarar vermeyecek şekilde geliştirilmesini ve kullanılmasını gerektirir [1]. YZ sistemlerinin insanlara zarar vermesi, insanların onlara güven duymasını engelleyecektir. Sistemlere güvenilmesi, onların kabul edilip yaygın bir şekilde kullanılabilmesi için sistemlerin zarar vermeme ilkesiyle uyumlu olması gerekir.

Yazan : Gamze Büşra Kaya

Referanslar

[1] S. Thiebes, S. Lins, and A. Sunyaev, “Trustworthy Artificial Intelligence,” Electronic Markets, vol. 31, no. 2, pp. 447–464, 2020.

[2] D. Kaur, S. Uslu, K. J. Rittichier, and A. Durresi, “Trustworthy Artificial Intelligence: A Review,” ACM Computing Surveys, vol. 55, no. 2, pp. 1–38, 2023.

[3] “Ulusal Yapay Zekâ Stratejisi (UYZS) 2021-2025- cbddo.gov.tr.” [Online]. Available: https://cbddo.gov.tr/SharedFolderServer/Genel/File/TR-UlusalYZStratejisi2021- 2025.pdf. [Accessed: 8-Sep-2022].